Într-un videoclip prezentat ca „educativ” despre mersul cu mașina, doi copii animați cântă și oferă „reguli” de trafic, în timp ce imaginile arată situații periculoase: copii fără centură, în fața mașinii, „plutind” lângă vehicule aflate în mișcare sau mergând pe mijlocul străzii. Clipul a strâns aproape 50.000 de vizualizări în cinci luni, iar o parte din mesaj este pur și simplu greșit („green means right”).

- De ce clipurile „slop” sunt mai riscante când publicul e format din copii mici

- Cât de mare este fenomenul

- Unde se blochează mecanismele de protecție: etichetare și moderare

- De ce prinde: combinația dintre nevoia părinților și „autoplay”

- Ce pot face părinții, realist, fără să transforme totul într-un „job”

- 1) Mutarea pe medii mai controlate

- 2) Previzualizarea „cap-coadă” a clipurilor noi

- 3) Preferarea canalelor cu identitate și istoric

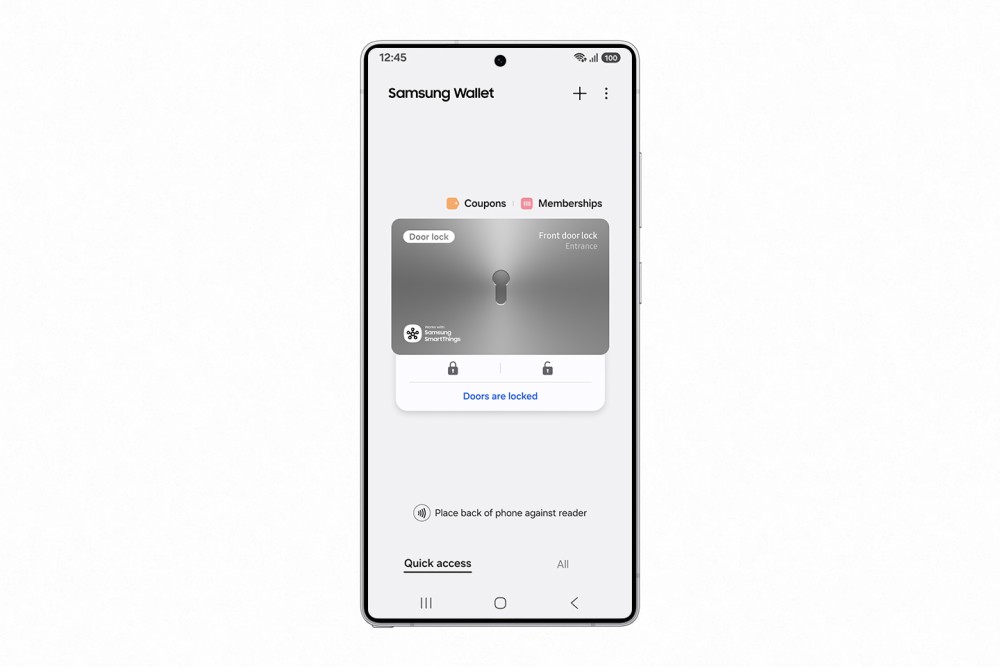

- 4) Setări simple: fără autoplay, playlisturi „curate”

- Ce urmează: presiune pentru etichete mai clare și standarde pentru „AI în media pentru copii”

Pentru experții în media pentru copii, acesta este un exemplu de „AI slop”: conținut generat rapid, în volum mare, cu erori și incoerențe, optimizat mai mult pentru a prinde vizualizări decât pentru a respecta standarde minime de calitate și siguranță.

Într-o investigație semnată de Emily Tate Sullivan pentru The 74, psihologul Kathy Hirsh-Pasek avertizează că problema abia începe, iar Dr. Dana Suskind (University of Chicago) o numește „toddler AI misinformation at an industrial scale”, subliniind că nu este „conținut neutru” pentru creierul aflat în dezvoltare.

De ce clipurile „slop” sunt mai riscante când publicul e format din copii mici

În cazul adulților, un videoclip incoerent e, de regulă, doar o pierdere de timp. În cazul copiilor mici, problema este că învățarea se face prin asociere repetată: „ce văd” + „ce aud” + „ce mi se spune că înseamnă”. Când aceste semnale nu se potrivesc (sunetul spune una, textul alta, imaginea altceva), copilul nu primește doar „informație falsă”, ci și un antrenament greșit al atenției și al relațiilor cauză–efect.

Carla Engelbrecht (creator de experiențe digitale pentru branduri educaționale și „whistleblower” pe zona de conținut AI pentru copii) avertizează că astfel de clipuri pot introduce lecții greșite despre alfabetizare, numere sau geografie, iar erorile apar uneori abia la mijlocul videoclipului – exact tipul de situație pe care un părinte grăbit o poate rata dacă verifică doar primele secunde.

Cât de mare este fenomenul

Măsurarea exactă e dificilă, însă rapoarte recente sugerează o prezență semnificativă a conținutului low-quality generat cu AI în recomandările YouTube. Kapwing a publicat în noiembrie 2025 un raport în care estimează că între 21% și 33% din feed poate fi compus din astfel de videoclipuri („AI slop” și „brainrot”), pe baza unei metodologii care include analiza canalelor „trending” și simularea experienței unui cont nou (primele 500 de Shorts).

Investigația The 74 oferă și un exemplu de „producție industrială”: canalul Jo Jo Funland (creditat ca autor al clipului „Vroom Vroom! Car Ride Song”) ar fi publicat peste 10.000 de videoclipuri în aproximativ șapte luni (din august 2025), adică o medie de circa 50 pe zi, în timp ce Sesame Street ar fi publicat aproximativ 3.900 de videoclipuri în 20 de ani pe platformă.

Unde se blochează mecanismele de protecție: etichetare și moderare

YouTube are o politică de „disclosure” pentru conținutul „altered or synthetic” atunci când acesta „pare realist” și poate induce în eroare privitorul. Problema, semnalată și în The 74, este că această cerință nu se aplică în mod automat animațiilor sau conținutului „clar nerealist”, categorie în care intră majoritatea clipurilor pentru copii.

În același timp, YouTube spune că are principii de calitate mai stricte pentru conținutul destinat copiilor și un set de politici de siguranță, iar un purtător de cuvânt a afirmat că platforma a luat măsuri împotriva unor canale în urma raportării (inclusiv închiderea a două). Totuși, volumul uriaș de conținut face ca aplicarea consecventă a regulilor să rămână o provocare.

De ce prinde: combinația dintre nevoia părinților și „autoplay”

Acest tip de conținut profită de un context banal: părintele are nevoie de 10–15 minute ca să termine o sarcină, copilul cere ceva „cu mașini”, iar titlul promite exact asta: „educațional”, „nursery rhyme”, „road safety”. Apoi intervine algoritmul și redarea automată, care poate ține copilul în aceeași zonă de conținut, chiar dacă următoarele clipuri nu mai au nicio garanție de calitate.

The 74 notează că YouTube Kids este o versiune separată, curată pentru 0–12 ani, însă multe familii folosesc platforma principală pentru conținut pentru copii, ceea ce păstrează publicul (și veniturile) pentru creatorii „faceless” care produc în masă.

Ce pot face părinții, realist, fără să transforme totul într-un „job”

Nu există o soluție perfectă, dar există câteva măsuri cu raport bun efort–beneficiu:

1) Mutarea pe medii mai controlate

Dacă e posibil, folosește YouTube Kids în locul aplicației principale, tocmai pentru că are filtre și controale parentale dedicate. Alternativ, există platforme curate pentru copii (de exemplu Sensical sau Meevee), chiar dacă ele concurează greu cu YouTube ca „obișnuință” de familie.

2) Previzualizarea „cap-coadă” a clipurilor noi

Pentru conținutul care pretinde că „învață” (litere, cifre, reguli de siguranță), verificarea primelor 10 secunde nu e suficientă: multe erori apar la mijloc.

3) Preferarea canalelor cu identitate și istoric

Un canal care publică zeci de videoclipuri pe zi e un semnal de „producție automată”. Asta nu dovedește, singur, că e periculos, dar crește probabilitatea de erori pentru că lipsește controlul editorial.

4) Setări simple: fără autoplay, playlisturi „curate”

Când copilul cere același tip de conținut, o soluție pragmatică este un playlist făcut de părinte cu 10–20 de clipuri verificate. Reduce șansa de a ajunge, prin recomandări, la materiale incoerente sau problematice.

Ce urmează: presiune pentru etichete mai clare și standarde pentru „AI în media pentru copii”

În materialele citate de The 74, producători și experți sugerează că etichetarea ar ajuta – nu ca soluție completă, ci ca „semnal” pentru părinți și ca element de alfabetizare AI. Discuția rămâne însă complicată: etichetele pot penaliza și creatorii care folosesc AI responsabil, în fluxuri de producție controlate, fără a renunța la verificare și expertiză umană.

Până la standarde mai clare și un filtru mai eficient la nivel de platformă, linia realistă este cea formulată de experți: conținutul pentru copii mici nu e „doar entertainment”. E input pentru dezvoltare — iar calitatea inputului contează.