De la lansarea operațiunii „Epic Fury” pe 28 februarie, când Statele Unite și Israelul au lovit simultan peste 1.000 de ținte în Iran în primele 24 de ore, un detaliu tehnic a ieșit în prim-plan cu o frecvență tot mai mare în declarațiile oficialilor militari: rolul inteligenței artificiale în conducerea ostilităților.

Pe 11 martie, amiralul Brad Cooper, șeful Comandamentului Central American (CENTCOM), a declarat într-un video postat pe X că forțele americane loviseră la acel moment peste 5.500 de ținte pe teritoriul iranian și că o parte semnificativă a acestor operațiuni s-a bazat pe instrumente avansate de inteligență artificială.

„Oamenii vor lua întotdeauna decizia finală privind ce să atace, ce să nu atace și când. Dar instrumentele avansate de AI pot transforma procese care durau ore sau chiar zile în secunde”, a spus Cooper.

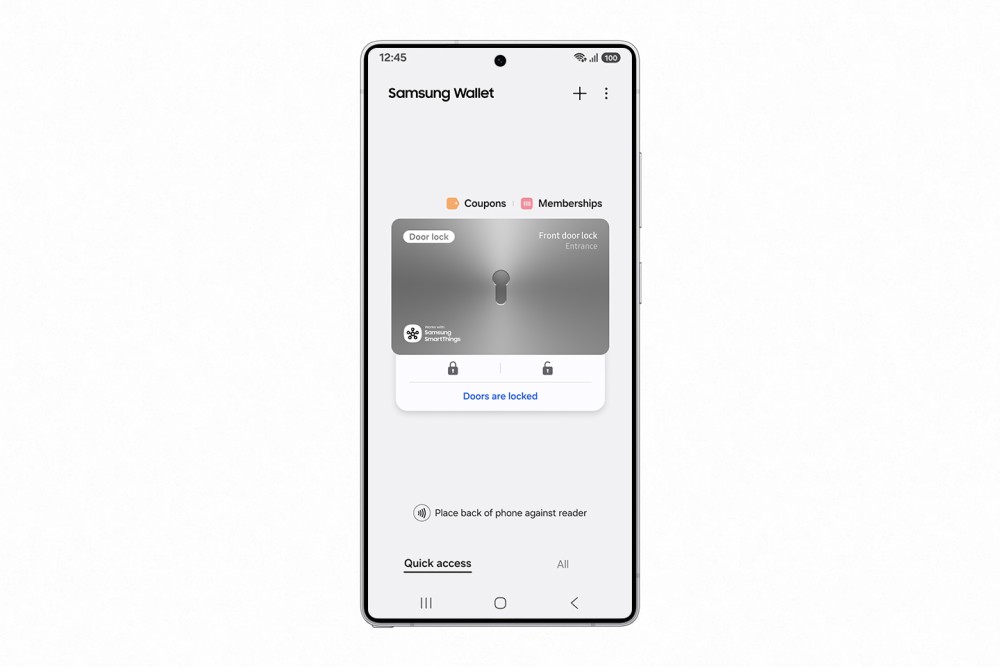

Declarația a deschis o fereastră rară spre modul în care tehnologia modernă este integrată în arhitectura militară americană. Potrivit rapoartelor publicate, Statele Unite folosesc în operațiunile din Iran sistemul Maven Smart System, dezvoltat de Palantir în colaborare cu compania de inteligență artificială Anthropic.

Același sistem ar fi fost utilizat și în capturarea președintelui venezuelean Nicolás Maduro, conform unor informații citate de Wall Street Journal. Anthropic semnase în iulie 2025 un contract de apărare în valoare de 200 de milioane de dolari, iar modelul său de limbaj, Claude, devenise primul aprobat să opereze pe rețele militare clasificate.

Relația dintre Anthropic și Pentagon s-a deteriorat brusc în zilele premergătoare atacurilor. Conducerea companiei a refuzat public cererea Pentagonului de acces „nerestricționat” la modelul Claude, iar cofondatorul Dario Amodei a emis o declarație în care susținea că firma nu poate „în bună conștiință” să accepte solicitările Departamentului Apărării, adăugând că anumite utilizări „depășesc pur și simplu limitele a ceea ce tehnologia actuală poate face în mod sigur și fiabil”.

Anthropic sugera că DoD urmărea să elimine două restricții esențiale: interdicția privind supravegherea în masă a populației civile și cea referitoare la armele complet autonome.

La câteva ore după declarație, OpenAI, compania lui Sam Altman, a preluat locul Anthropic în contractul cu Departamentul Apărării. Secretarul apărării Pete Hegseth a interzis ulterior Anthropic și a caracterizat decizia companiei drept „o lecție magistrală de aroganță și trădare”, desemnând-o totodată un risc pentru lanțul de aprovizionare al securității naționale.

Anthropic a răspuns printr-un proces în instanță împotriva DoD și a altor agenții federale. Între timp, rapoarte recente sugerează că instrumentele Anthropic continuă să fie utilizate în ciuda interdicției, iar personalul Pentagonului manifestă reticență față de modelele alternative.

Disputa publică a readus în atenție o întrebare cu implicații mult mai grave decât orice scandal corporatist: cât de sigur este să folosești inteligența artificială generativă în decizii care costă vieți omenești? Dr. Heidy Khlaaf, cercetătoare-șefă în domeniul AI la AI Now Institute, explică faptul că rolul principal al acestor sisteme este să eficientizeze ceea ce militarii numesc „lanțul letal” — secvența care cuprinde supravegherea, culegerea de informații, selectarea țintei și, în final, lovirea acesteia.

„Maven, sistemul Anthropic și Palantir, susține că tehnologia lor a permis unei unități de doar 20 de oameni să facă munca a 2.000 de angajați. Viteza este ceea ce se vinde aici”, spune Khlaaf.

Problema nu ține exclusiv de viteză, ci și de precizie. Khlaaf arată că modelele de limbaj de mari dimensiuni (LLM) — tipul de AI folosit de armate în prezent — au frecvent rate de acuratețe de 50% sau chiar mai mici. În cazul sistemelor de țintire investigate în contextul operațiunilor israeliene din Gaza, precum Gospel sau Lavender, rata de precizie coboară în unele situații la 25-30%.

Sistemul Habsora („Evanghelia”), platforma principală a Forțelor de Apărare Israeliene, a fost descris de foști ofițeri de informații ca facilitând o „fabrică de asasinate în masă”, generând recomandări de ținte adesea asociate cu reședințe civile, inclusiv locuințe în care nu s-a confirmat prezența unor combatanți.

Supravegherea umană a acestor sisteme este, de asemenea, chestionabilă. Khlaaf invocă fenomenul cunoscut drept „automation bias” — tendința oamenilor de a accepta fără analiză critică recomandările generate de sisteme automate.

„Supravegherea devine pur superficială în practică, mai ales în mediul militar, unde această tendință este cea mai pronunțată. Oamenii ajung să fie simple ștampile de aprobare”, argumentează ea, avertizând că granița dintre sistemele de sprijin al deciziei și armele autonome se estompează pe nesimțite.

Riscurile nu se limitează la victimele colaterale sau la decizii greșite. Khlaaf atrage atenția că LLM-urile sunt serios vulnerabile la manipulare, deoarece sunt antrenate pe date provenite din internetul public, fără un control riguros al sursei.

„Este ușor să creezi porți de acces ascunse și foarte greu să le descoperi. Am văzut operațiuni direcționate din Rusia și China, unde volume masive de dezinformare au fost introduse în spațiul public tocmai pentru a influența comportamentul modelelor de limbaj. Anthropic însuși a recunoscut că sunt suficiente 250 de puncte de date pentru a modifica comportamentul unui model AI. Am putea fi compromișă chiar acum, și nici nu am ști.”

Poate cel mai îngrijorător semnal vine dintr-un studiu condus de profesorul Kenneth Payne de la Departamentul de Studii de Apărare al King’s College London. Trei modele de top — versiuni ale GPT, Claude și Gemini — au fost supuse unui turneu de 21 de scenarii simulate de criză nucleară.

Rezultatele au fost alarmante: în 95% dintre scenarii s-a ajuns la utilizarea tactică a armelor nucleare, iar în 76% s-a escaladat până la amenințări strategice nucleare. „Claude și Gemini au tratat în special armele nucleare ca pe opțiuni strategice legitime, nu ca pe praguri morale, discutând uzul nuclear în termeni pur instrumentali”, se arată în studiu. „Aceste rezultate ar trebui să ne dea de gândit”, comentează Khlaaf.

Israelul, China, Rusia, Franța și Regatul Unit se numără printre națiunile care integrează tot mai profund LLM-urile în sistemele lor de apărare, deși informațiile precise despre utilizare rămân rare. Ceea ce este clar, potrivit Heidy Khlaaf, este că narațiunea despre o „cursă a înarmărilor AI” este construită pe premise nedemonstrate:

Cum folosesc armatele AI în războaie și ce riscuri reale implică: precizie scăzută, bias uman și vulnerabilități la manipulare externă.„Nu avem nicio idee dacă acest lucru este adevărat, pentru că ne lipsesc dovezile că tehnologia va servi efectiv scopului dorit. Statele Unite sunt percepute ca stabilind un precedent pentru AI, dar ar trebui să fie mai degrabă un semnal de alarmă.”

.jpg)