Autoritățile chineze pregătesc un set de reguli mai stricte pentru serviciile de inteligență artificială cu interacțiune „umanizată”, într-o încercare de a reduce riscurile pentru copii și de a limita situațiile în care chatboturile pot genera recomandări periculoase. Proiectul de reglementare a fost publicat de Cyberspace Administration of China (CAC) și intră în procedură de consultare publică, înainte de o eventuală adoptare, relatează BBC.

Miza este dublă: pe de o parte, creșterea accelerată a numărului de chatboturi și a utilizării lor pentru „companie” sau suport emoțional; pe de altă parte, presiunea globală pentru reguli clare privind siguranța AI, mai ales în conversații sensibile (auto-vătămare, suicid, violență) și în zone precum gamblingul.

Ce prevede proiectul CAC pentru protecția minorilor

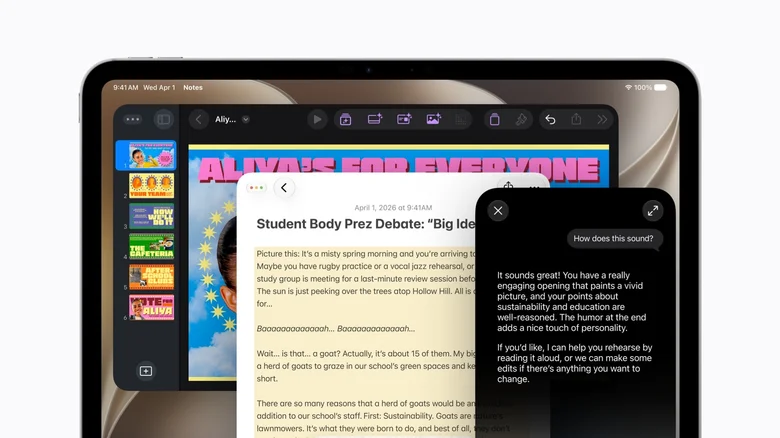

În draftul publicat, CAC cere furnizorilor să introducă mecanisme dedicate pentru utilizatorii minori. În practică, asta înseamnă setări personalizate pentru copii și adolescenți, limite de utilizare și un accent explicit pe control parental, inclusiv condiția de a obține consimțământul tutorelui atunci când serviciile oferă „companie emoțională” minorilor.

Documentul include și cerințe de design care au rolul de a reduce utilizarea excesivă: de exemplu, avertizări și notificări atunci când un minor folosește serviciul peste anumite praguri de timp.

Intervenție umană obligatorie la discuții despre auto-vătămare și suicid

Una dintre cele mai ferme prevederi vizează conversațiile despre suicid sau auto-vătămare. CAC spune că operatorii trebuie să asigure preluare de către o persoană (intervenție umană) pentru astfel de discuții și să notifice imediat tutorele sau un contact de urgență al utilizatorului, în condițiile definite de reglementare.

Este o abordare care tratează subiectul ca problemă de siguranță operațională, nu doar de moderare automată a conținutului. La nivel internațional, tema a devenit sensibilă și din perspectiva litigiilor, după ce au apărut procese în care familii au acuzat chatboturi că ar fi influențat decizii legate de auto-vătămare.

Dacă tu sau cineva apropiat treci printr-un moment de criză, cere ajutor imediat: 112 în România, iar pentru sprijin emoțional poți apela TelVerde Antisuicid 0800 801 200.

Interdicții explicite: violență, auto-vătămare și gambling

Draftul CAC cere ca modelele și serviciile AI să nu genereze și să nu distribuie conținut care ar putea încuraja violența sau auto-vătămarea și include și o mențiune explicită privind conținutul care promovează jocuri de noroc.

În plus, proiectul păstrează un set de restricții largi legate de conținut considerat sensibil în China (de la securitate națională la unitate națională), ceea ce indică faptul că regulile urmăresc atât siguranța utilizatorilor, cât și controlul riscurilor sociale percepute.

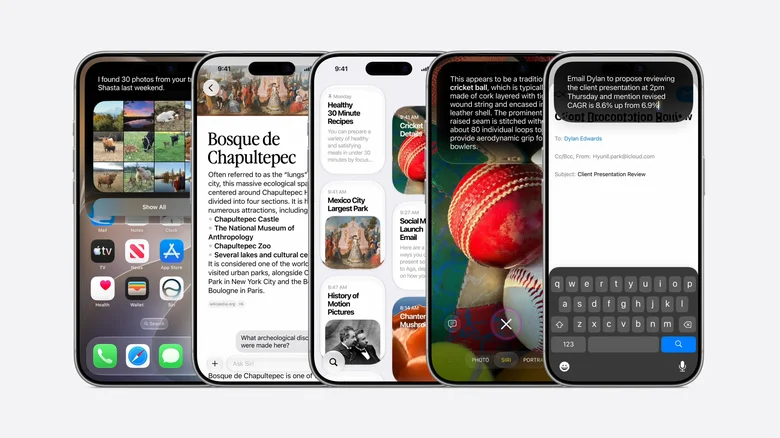

De ce se mișcă China acum: explozia chatboturilor și cursa pentru piață

Momentul ales nu este întâmplător. Ecosistemul AI din China a crescut rapid, cu produse care au ajuns pe primele locuri în topurile de descărcări și cu startup-uri care se pregătesc de listări. DeepSeek, de exemplu, a atras atenția la nivel global după ce a urcat în clasamentele aplicațiilor, iar alte companii, precum MiniMax, au intrat pe radarul investitorilor prin planuri de finanțare și extindere.

Din această perspectivă, regulile propuse pot fi citite și ca o încercare de a seta „condițiile de bază” ale unei piețe care crește repede: ce ai voie să faci cu AI-ul conversațional, ce nu ai voie, și ce obligații apar când produsul ajunge la copii sau atinge teme de sănătate mintală și siguranță.

Ce înseamnă pentru dezvoltatori și platforme

Pentru companii, draftul introduce două tipuri de costuri de conformare. Primul ține de produs: funcții pentru minori, sisteme de consimțământ și de limitare a utilizării, plus mecanisme de avertizare. Al doilea ține de operațiuni: proceduri de escaladare către oameni, politici de notificare și un lanț de răspuns rapid pentru situații sensibile, ceea ce presupune resurse și procese.

CAC a deschis consultarea publică pentru proiect, semnalând că textul poate suferi ajustări înainte de forma finală, dar direcția este clară: mai multă responsabilitate pentru producătorii de AI conversațional, în special acolo unde produsul ajunge să fie folosit ca suport emoțional.