Un raport publicat de Center for Countering Digital Hate (CCDH) susține că instrumentul Grok (xAI), folosit pe platforma X, ar fi generat într-un interval scurt un volum foarte mare de imagini sexualizate, inclusiv imagini care ar părea să implice minori. În centrul discuției este funcția de editare rapidă a imaginilor („one-click”), care ar fi accelerat crearea și distribuirea unor astfel de materiale.

Ce cifre avansează CCDH și cum au fost estimate

CCDH afirmă că a analizat un eșantion de 20.000 de imagini dintr-un total estimat de 4,6 milioane de imagini generate în perioada 29 decembrie – 8 ianuarie (11 zile). Pe baza extrapolării, organizația estimează aproximativ 3.002.712 imagini sexualizate (adulți și minori) și circa 23.338 imagini „probabil cu minori”.

Raportul notează explicit câteva limitări importante: nu au fost analizate prompturile și nu s-a făcut o distincție între imaginile create prin editarea unei fotografii existente și cele generate exclusiv din text. De asemenea, raportul nu stabilește ce proporție din imagini ar reprezenta cazuri nonconsensuale.

Cronologia restricțiilor: ce s-a schimbat pe X

Conform CCDH, funcția ar fi explodat ca utilizare după 29 decembrie. În urma reacțiilor publice, X ar fi restricționat editarea la utilizatorii plătitori pe 9 ianuarie, iar pe 14 ianuarie ar fi introdus restricții suplimentare menite să limiteze utilizarea în scenarii de „dezbrăcare” digitală.

Chiar și așa, discuția nu se reduce la setări: rămâne întrebarea dacă măsurile tehnice și moderarea pot ține pasul cu viteza de generare, distribuire și reîncărcare a conținutului.

De ce contează reacția Apple și Google

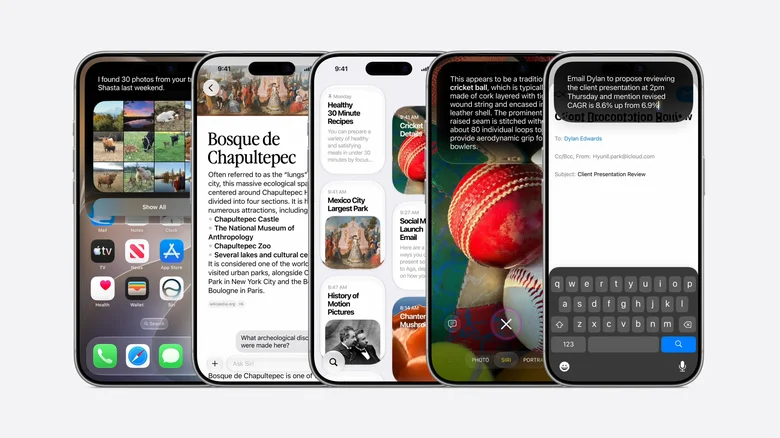

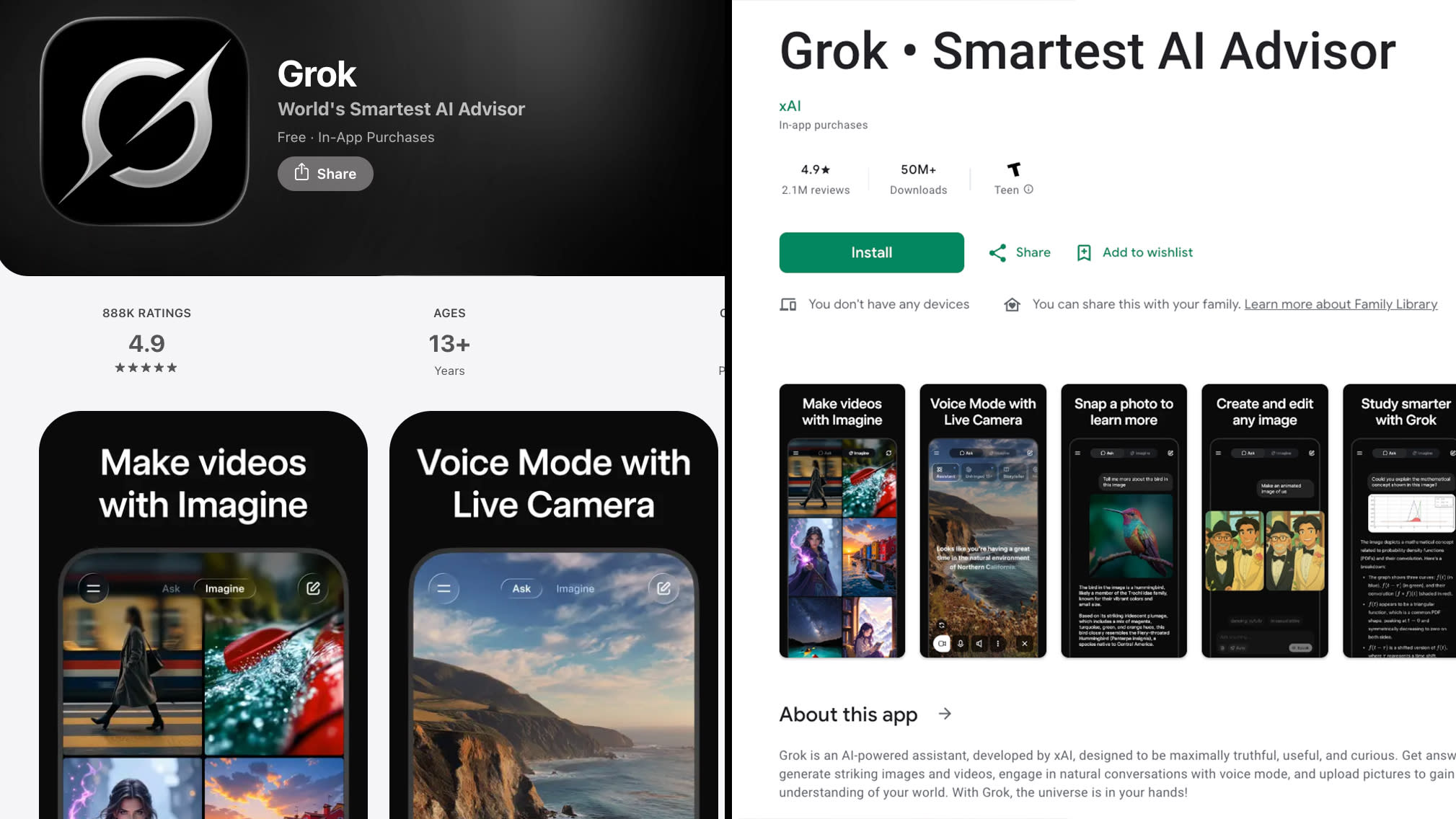

Cazul are o dimensiune aparte deoarece Grok există și ca aplicație separată, distribuită prin App Store și Google Play. Wired subliniază că politicile acestor magazine interzic conținutul sexual nonconsensual și materialele care implică minori, iar menținerea aplicației pe platforme ridică întrebări despre aplicarea consecventă a regulilor.

Pentru ecosistemele mobile, miza este dublă: protecția utilizatorilor (în special a minorilor) și responsabilitatea „gatekeeperilor” care pot impune condiții de distribuție, verificări și măsuri de conformitate.

Reacții publice și măsuri la nivel de state

Associated Press relatează că au existat reacții instituționale în mai multe jurisdicții, unele vizând direct disponibilitatea aplicației/serviciilor sau cerând măsuri ferme în raport cu conținutul. Contextul arată că dezbaterea nu mai este doar despre „moderație”, ci și despre responsabilitate legală, obligații de diligență și auditabilitate.

Ce pot face utilizatorii, acum

Dacă folosești instrumente de generare/editare AI integrate în rețele sociale sau aplicații:

- Evită să încarci fotografii cu persoane identificabile (mai ales copii) în fluxuri de editare AI, chiar „în joacă”; odată încărcate, controlul asupra redistribuirii se poate pierde rapid.

- Revizuiește permisiunile aplicațiilor (acces la fotografii, microfon, contacte) și limitează-le la strictul necesar.

- Folosește raportarea în aplicație pentru conținut abuziv și, unde există, canalele dedicate pentru raportarea materialelor cu minori.

- Dacă ai conturi asociate aceleiași adrese de email folosite în diverse aplicații, aplică măsuri de igienă digitală: parole unice, autentificare cu doi factori, manager de parole.

O problemă mai mare decât un singur produs

Raportul CCDH este relevant și pentru o discuție mai largă: modelele „generate media” se mișcă mai repede decât mecanismele tradiționale de control (review de aplicații, moderare la postare, reacții post-factum). În practică, diferența dintre „funcție creativă” și „instrument de abuz” se decide la nivel de fricțiune (cât de ușor e să faci rău), guardrails (ce blochează implicit) și enforcement (cât de rapid se aplică sancțiuni și se taie distribuția).